ホーム

>> ヘッドライン

>>

PC修理のわたなべ

ホーム

>> ヘッドライン

>>

PC修理のわたなべ

| メイン | 簡易ヘッドライン |

|

|

現在データベースには 492 件のデータが登録されています。

はじめに

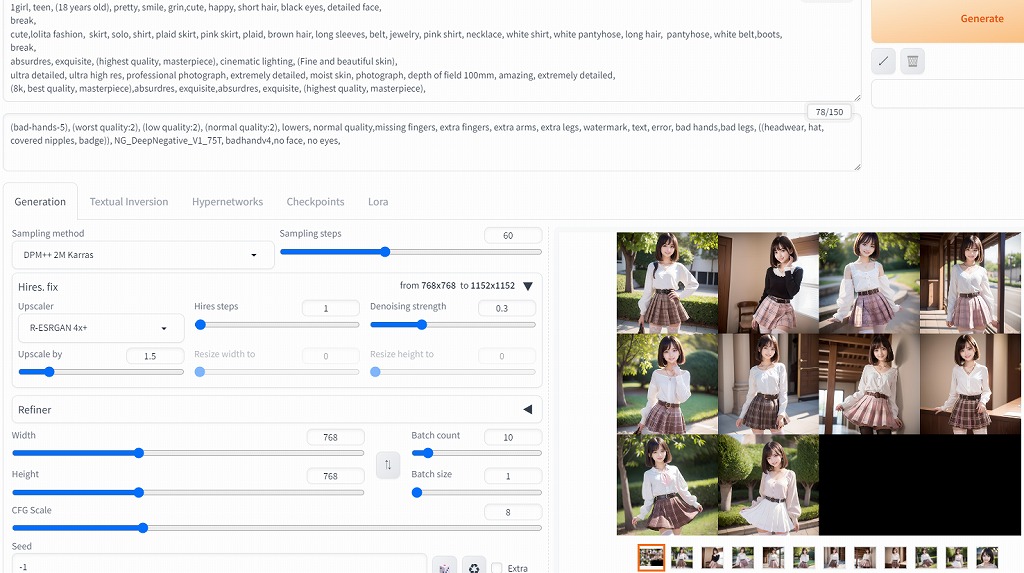

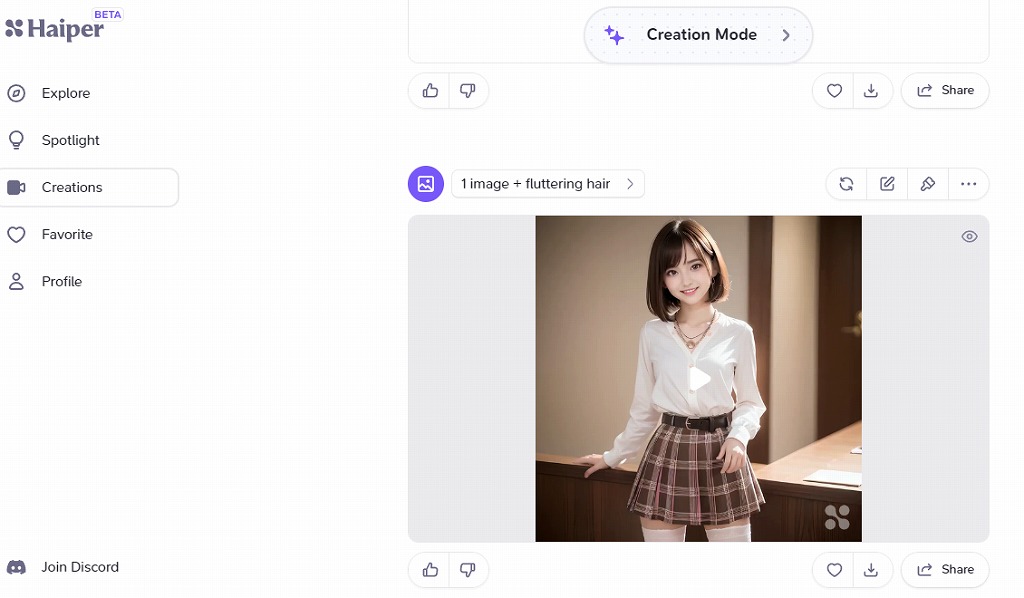

新しい動画生成AIをみつけた

参照サイト

生成過程

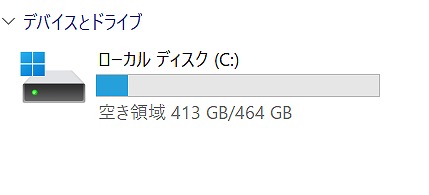

画像生成 (Stable Diffusion)

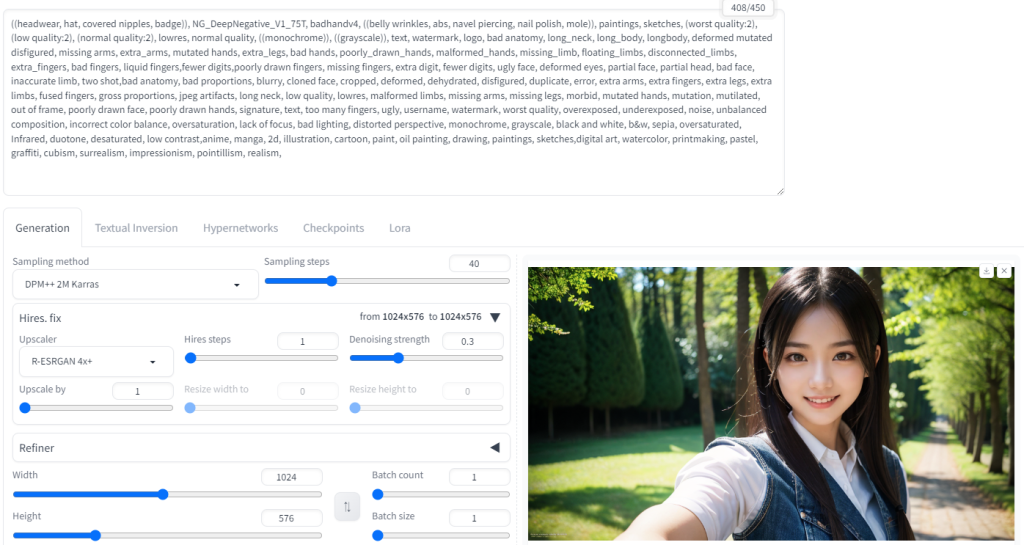

動画生成AI (Haiper.ai)

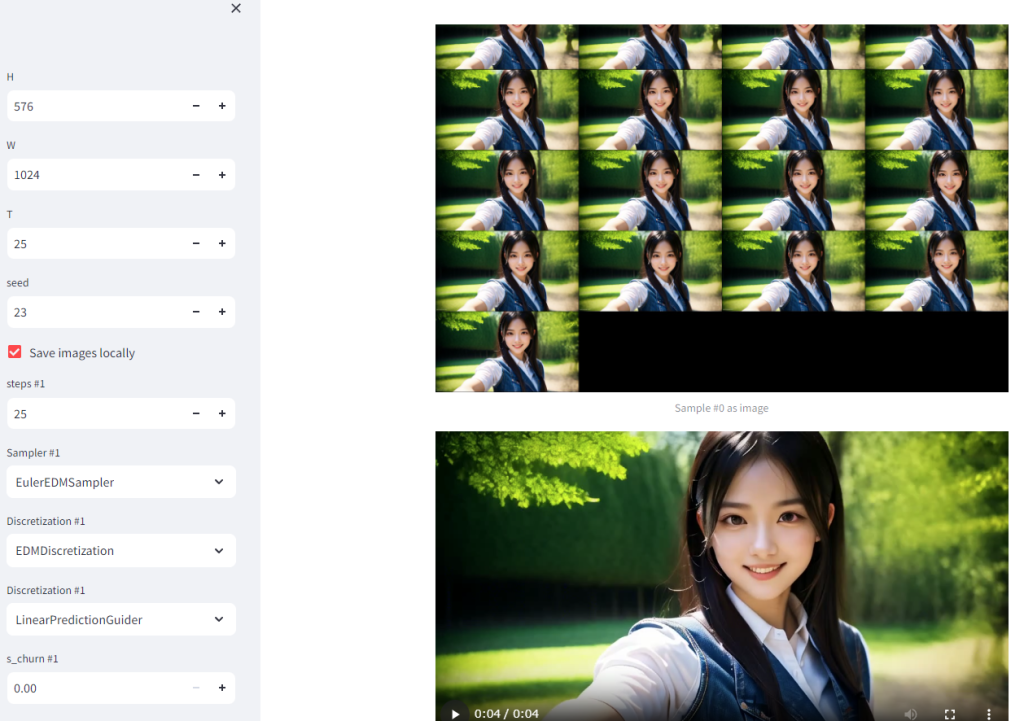

動画編集 (VideoProc Vlogger)

動画完成

おまけ

はじめに

Windows 10は22H2最終バージョン、サポート期限は 2025年10月14日 となっております。

OS起動が遅く、サポート期限前にWindows11にアップグレードを依頼された。

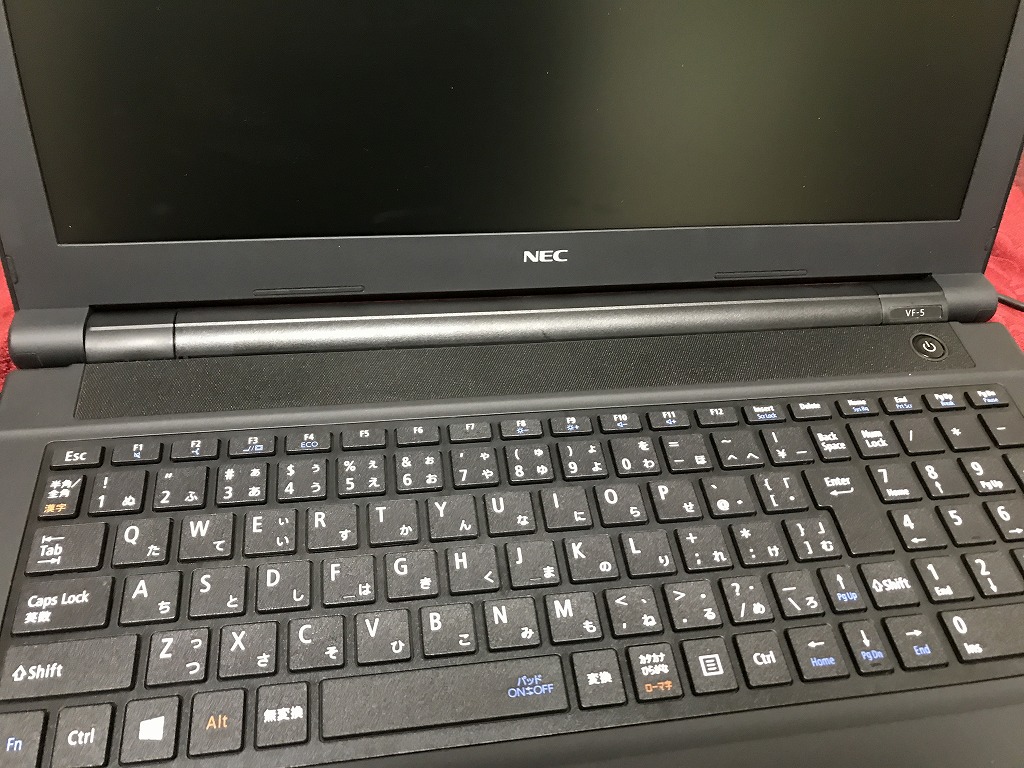

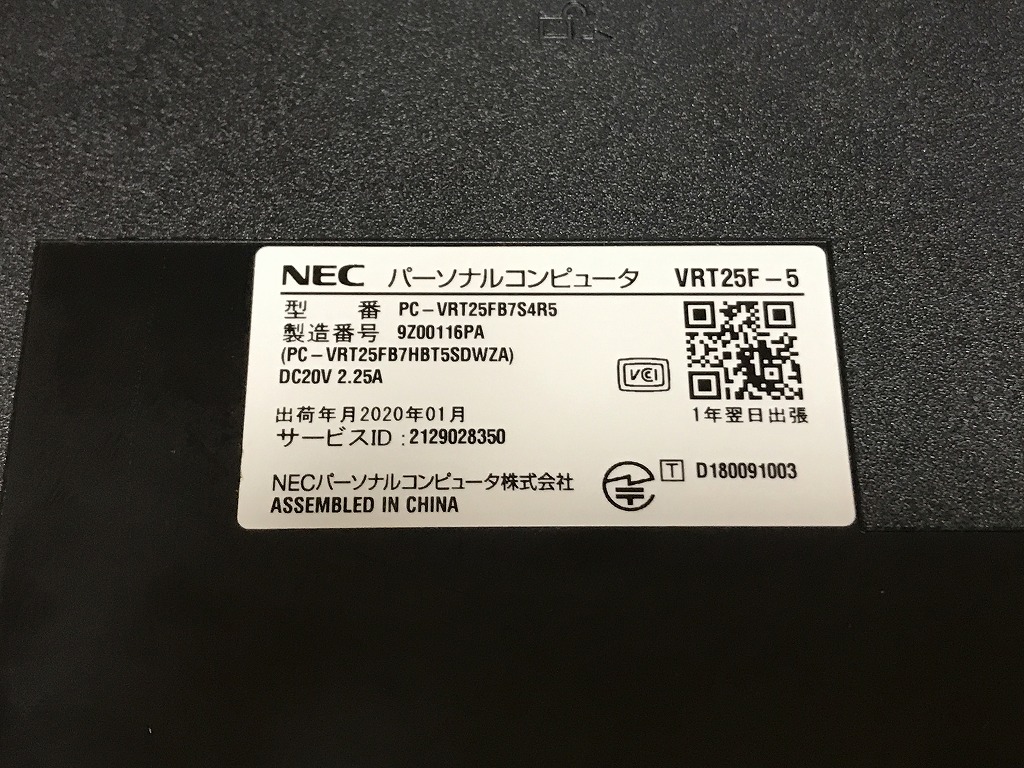

【機種/型番】NEC VRT25F-5 (PC-VRT25FB7S4R5)

パソコン修理の過程

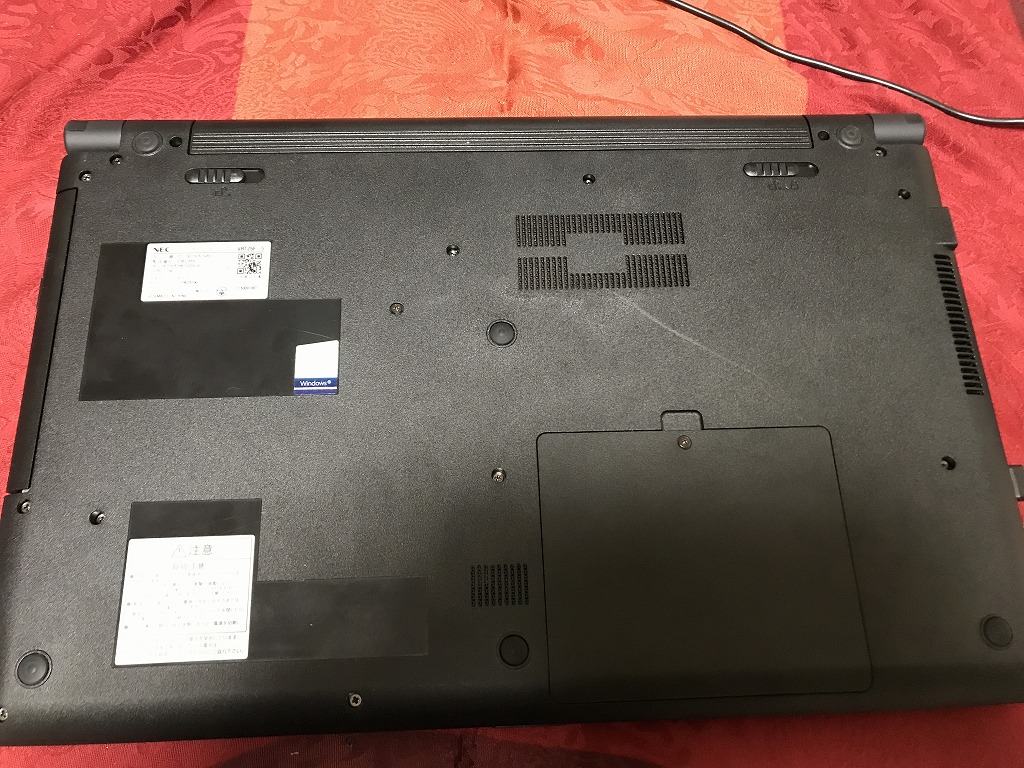

パソコンの分解

裏面のネジを外す

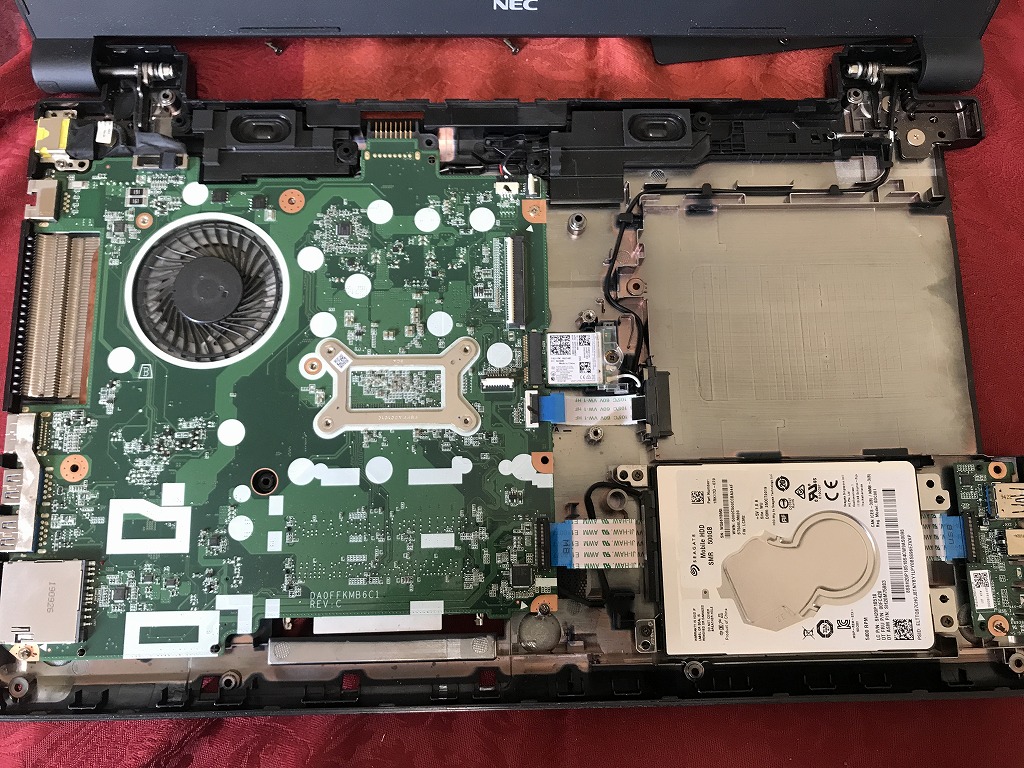

キーボードを外し、ネジを外す

表面側を外し、HDDを取り外す

- HDDデータをSSDへ丸ごとコピー(HDDからSSDへ換装)

- SSDを本体へ戻す

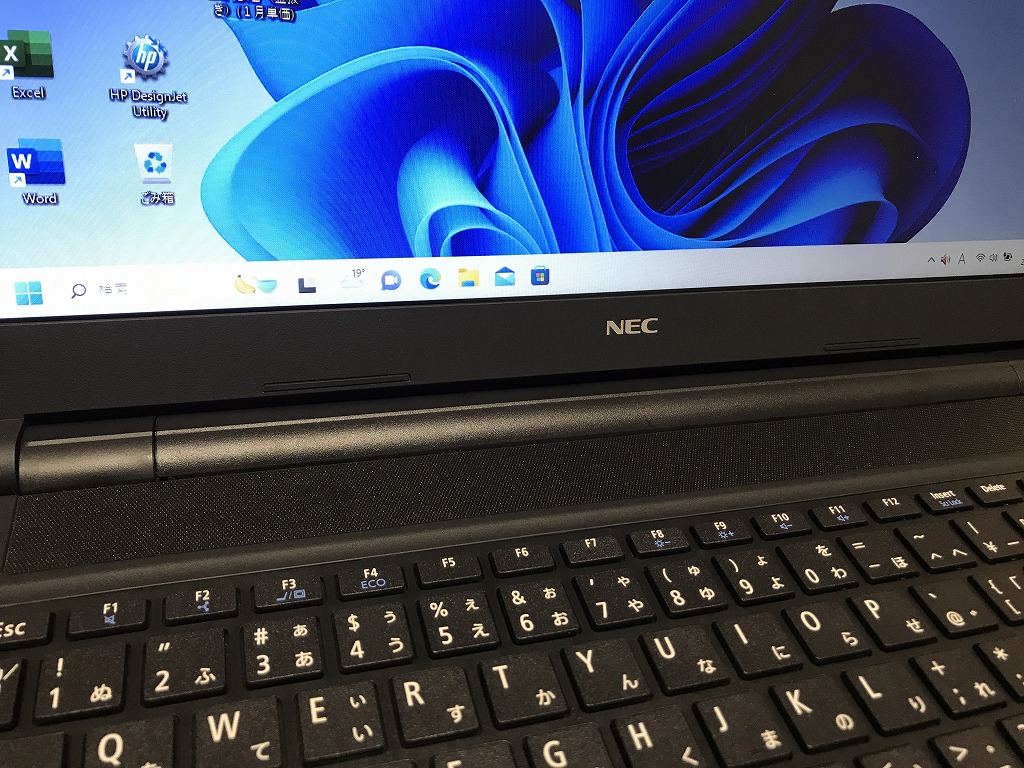

- Windows10からWindows11へアップグレード

パソコン修理の終了

本体を起動し、Windows11を確認

最後に

- ウィルス除去

- パソコン最適化&高速化

- クリーニング

パソコン起動も10秒程度に高速になり、無事にWindows11へアップグレードが成功してよかったです。

はじめに

ロゴ素材を作成したいと思い、探していたところ、興味深いサイトをみつけた。

参考サイト

『Stable Diffusion WEB UIで簡単! ステッカー・アイコン・ロゴ素材の作り方』

作成過程

参考サイトと同様な素材を作成してみました。

?プリントステッカー風

(high resolution:1.5),logo design art,Vivid Colors,cool,Messily painted,smooth vector,(white background),punk and wolf

motif,

neg:(worst quality:2),(low quality:2),

?ステッカーロゴ風

(high resolution:1.5),2d ferocious wolf head, vector illustration, angry eyes, team emblem logo, 2d flat, centered

nega:(worst quality:2),(low quality:1.4),((3d, cartoon)),

?アートロゴ風

(high resolution:1.5),futuristic minimalistic centered stylized logo of a subject,botanical motif white with black

background, smooth vector, typo

nega:(worst quality:2),(low quality:1.4),((3d, cartoon)),

?モダンアイコン風

(high resolution:1.5),Clean, sharp, vectorized, Company logo,castle and sword motif,icon,trending,modern and

minimalist,monochrome,

neg:(worst quality:2),(low quality:1.4),((3d, cartoon)),

?アイコン風

(highly detailed),Simple and iconic logo design chart of combining (castle:1.2) motifs, (chain) accent, vector drawing,

trending on behance ,simple, minimal

nega:(worst quality:2),(low quality:2),

?シンプルロゴ風

simple symbol logo,stylish,cool,white background,vector,flat,

nega:(worst quality:2),(low quality:1.4),((3d, cartoon)),

息抜きをも兼ねて、遊ばせていただきました。

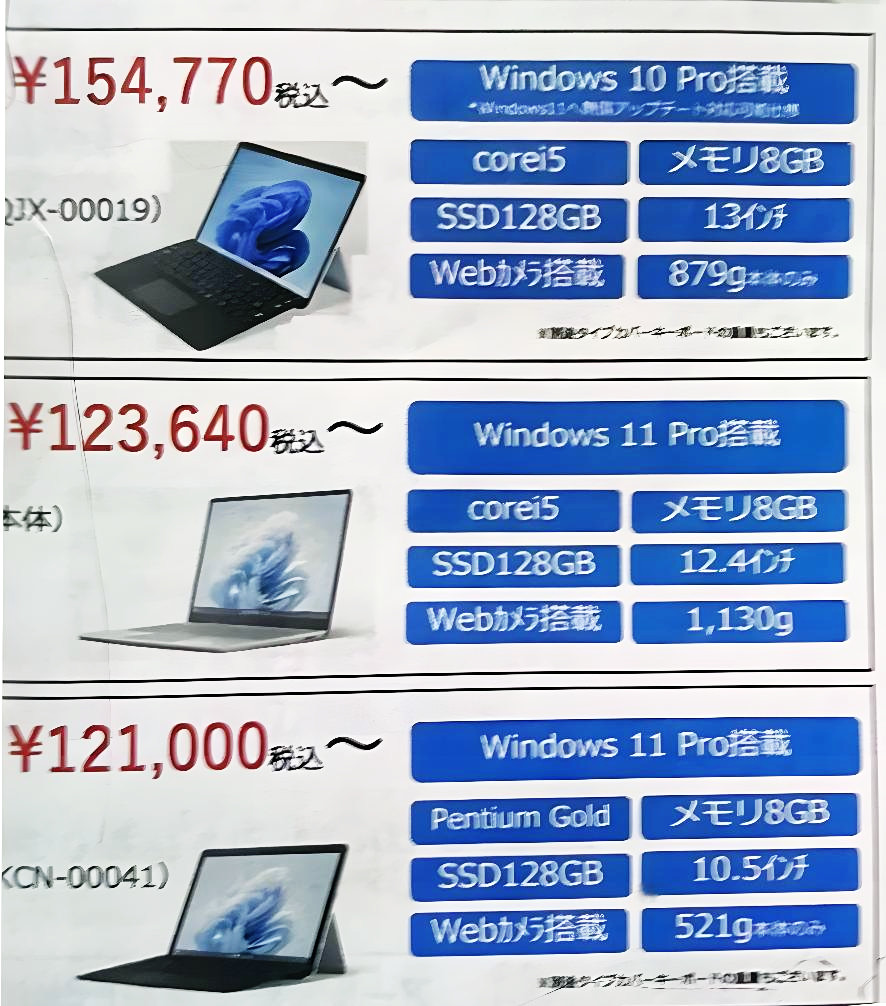

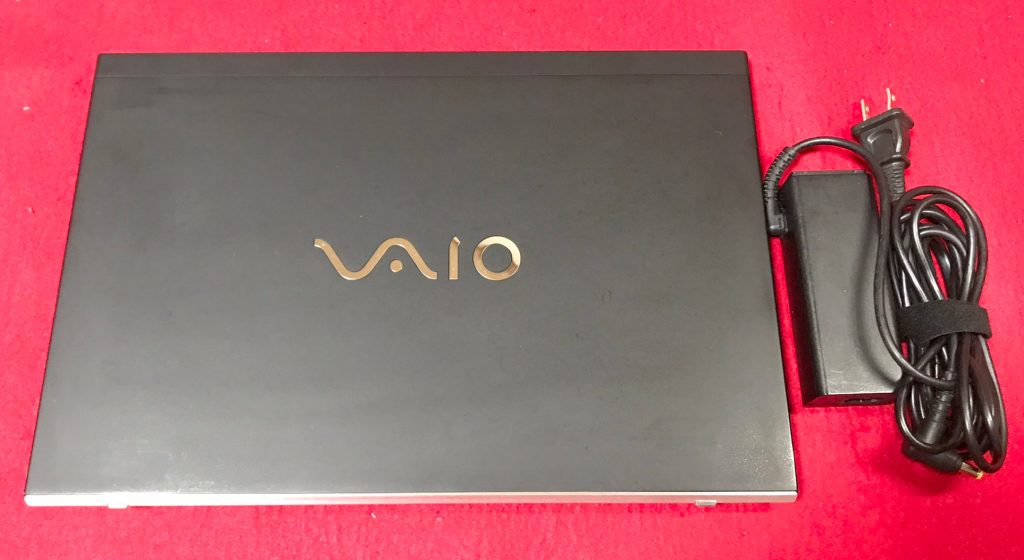

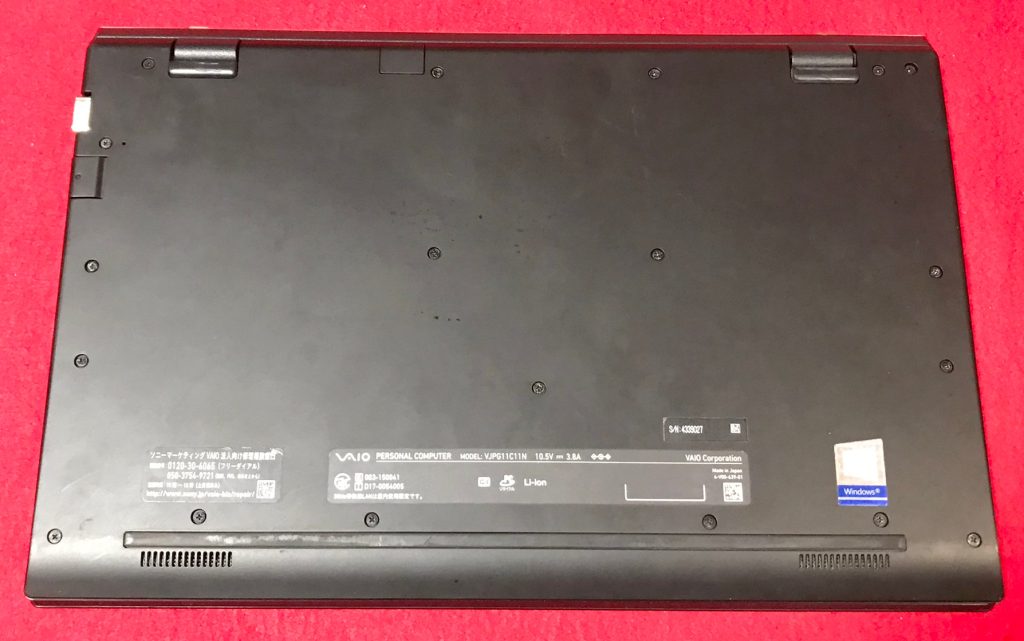

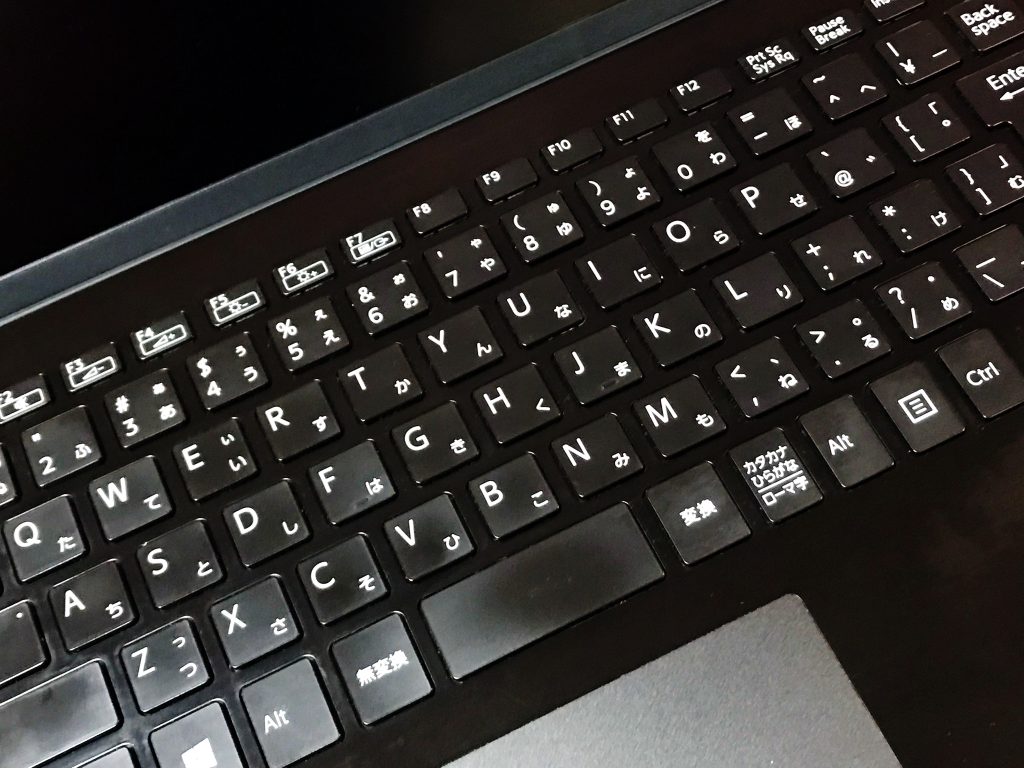

63800円 →? 58000 円(※在庫処分)

第7世代☆VAIO☆VJPG11C11N☆Core i5 2.50GHz/8GB/SSD256GB/無線/Bluetooth/WEBカメラ/ Office 2021 /Win11

参考資料

ある学校に配布されたパソコン販売パンフレット

ギャラリー

説明

Intel Core i5プロセッサー&メモリ8GB搭載で、動作も快適♪

- Core i5

- SSD 256GB

- 超軽量で丈夫なモデルです。その上、性能も申し分ありません。

- 高性能なCPUの Core i5 、 SSD256GB (読み書きが速い!)と,大容量 メモリ8GB です。

- 最新の Microsoft office 2021 Professional Plus インストール済み!

無線LAN内蔵なので、家の中でもケーブル不要・場所を選ばずネットが出来ます!

使用感も少なく、ある程度美品に思います。

| 状態 | 中古品【美品】 |

|---|---|

| パソコンメーカー | VAIO |

| 型番 | VJPG11C11N |

| カラー | ブラック |

| CPU | Core i5-7200U プロセッサー 2.50 GHz (最大3.10 GHz) |

| メモリ | 8 GB |

| ストレージ | SSD 256GB |

| 表示能力 | 13.3型 |

| 解像度 | 1920×1080ドット |

| OS | Windows11 Pro |

| ソフト | Microsoft Office Professional plus 2021 |

| 光学ドライブ | 無 |

| ネットワーク | 有線:〇 / 無線:○ |

| 接続端子 | USB (USB 3.0) 給電機能付き × 1、USB (USB 3.0) × 2 |

| 内蔵機能 | WEBカメラ / Bluetooth / スピーカー / テンキー |

| インターフェース | SDカードスロット(SDHC・SDXC対応) HDMI ® 出力端子×1 |

| 付属品 | 電源アダプタ / ACケーブル |

| 外形寸法 | 約 1.06 k g |

料金

税込? 63800円 ?(税抜58000円)→? 58000 円(※在庫処分)

お問い合わせ

※商品タイトルを「題名」にコピーして送信してください

[contact-form-7]

79200円 → 72000 円 ?(※在庫処分)

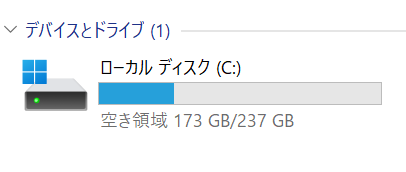

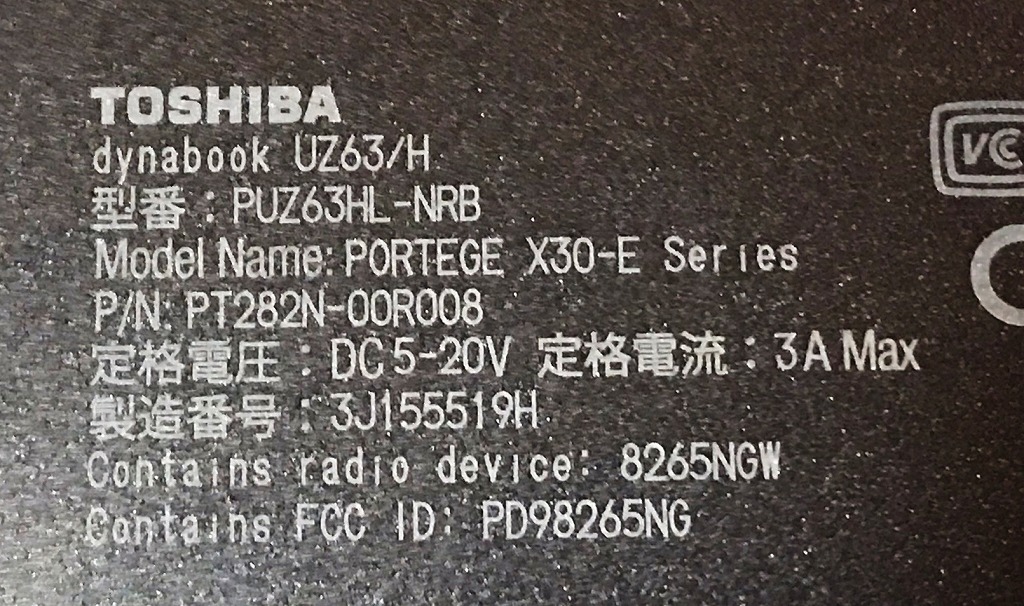

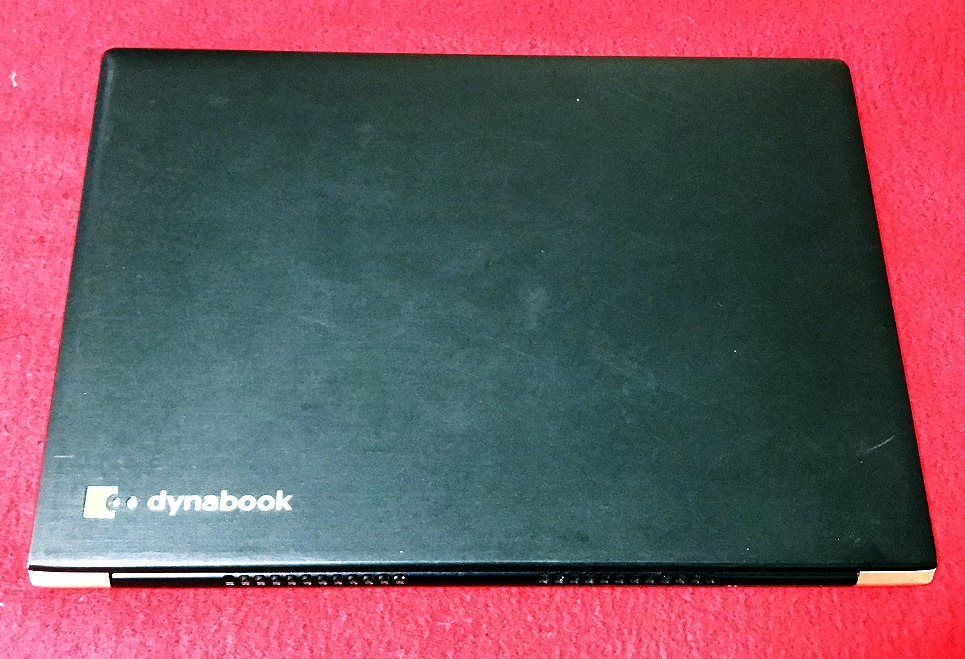

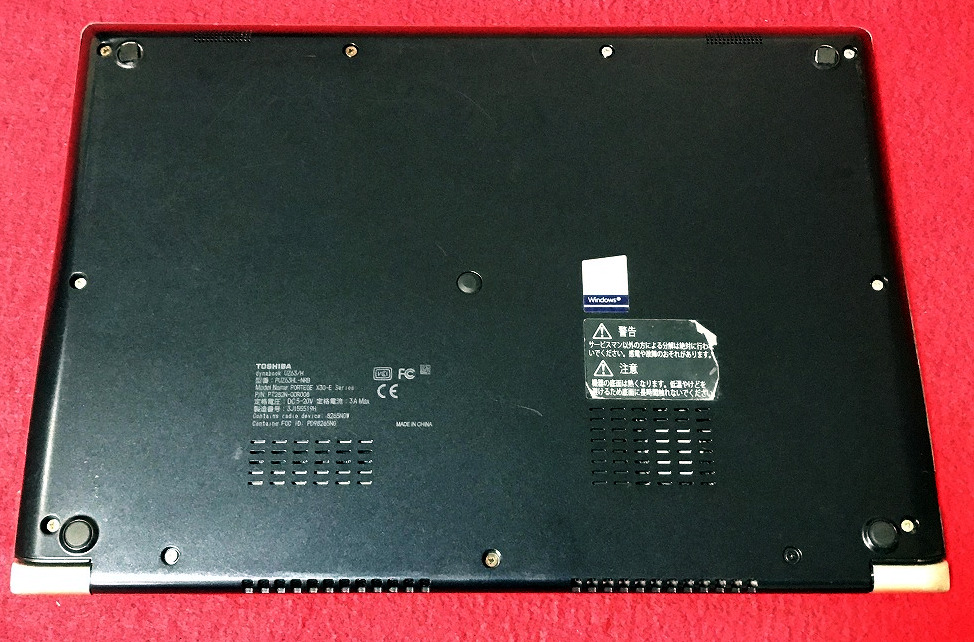

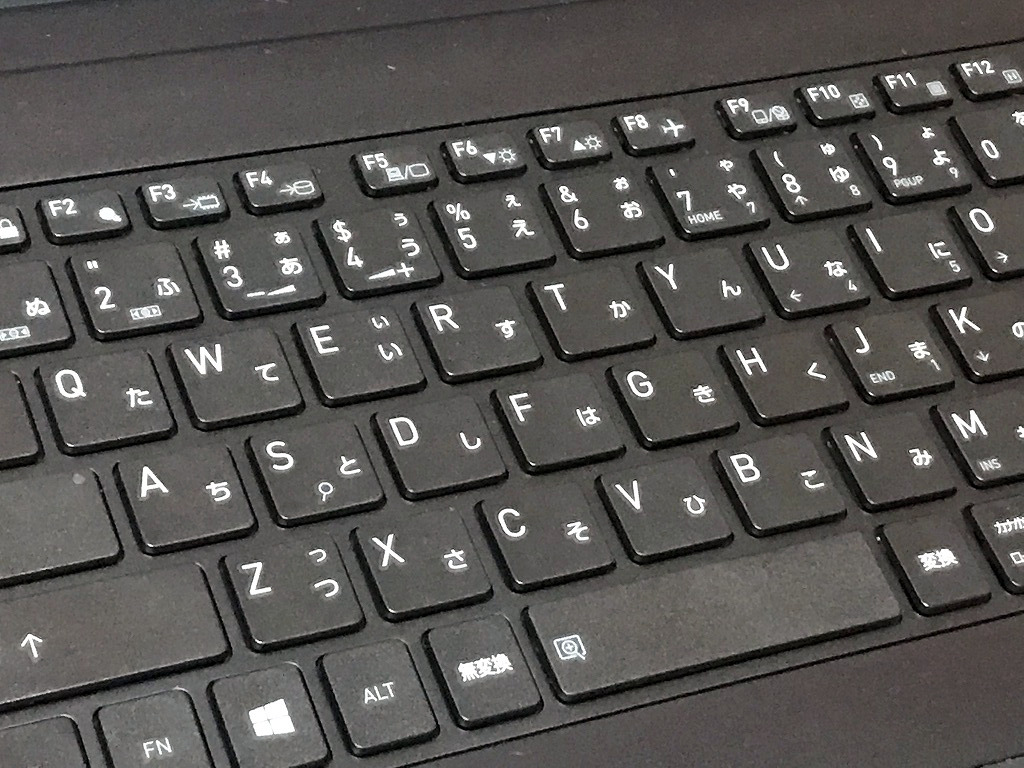

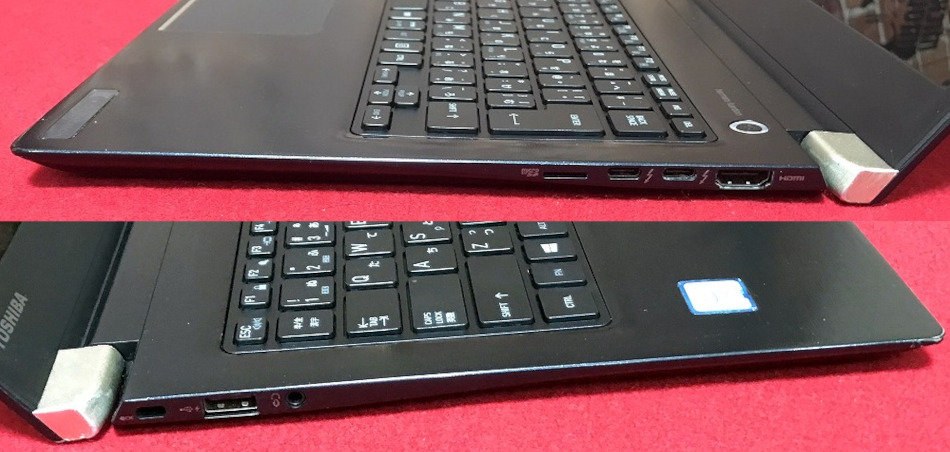

【爆速SSD☆Win11 Pro】TOSHIBA dynabook UZ63/H ☆新品M.2 SSD1TB!/Core i7/新品キーボード/新品バッテリー/メモリ8GB/MS Office 2021

参考資料

ある学校に配布されたパソコン販売パンフレット

ギャラリー

説明

Intel Core i7プロセッサー&メモリ8GB搭載で、動作も快適♪

- M.2 NVMe SSD 1TB(1000GB)【新品】

※一般的なSSDより高速 - キーボード換装 【新品】

- バッテリー換装 【新品】

- 超軽量で丈夫なモデルです。その上、性能も申し分ありません。

- 新品キーボードに換装 しましたので、きれいな状態です。

- バッテリーも純正新品に換装 しましたので、外出先での使用も安心です。

- harman/kardonのスピーカーシステムでいい音です。

- 高性能なCPUの Core i7 (第8世代)、大容量の新品 M.2 SSD1TB (読み書きが速い!)と,大容量 メモリ8GB で、動画編集もいけます。

- 最新の Microsoft office 2021 Professional Plus インストール済み!

無線LAN内蔵なので、家の中でもケーブル不要・場所を選ばずネットが出来ます!

使用感も少なく、ある程度美品に思います。

| 状態 | 中古品 |

|---|---|

| パソコンメーカー | TOSHIBA |

| 型番 | dynabook UZ63/H |

| カラー | ブラック |

| CPU | インテル Core i7-8550U |

| メモリ | 8 GB |

| ストレージ | M.2 NVMeSSD 1TB(1000GB)【新品】 |

| 表示能力 | 13.3型 FHD |

| 解像度 | 1,920×1,080ドット |

| OS | Windows11 Pro |

| ソフト | Microsoft Office Professional plus 2021 |

| 光学ドライブ | 無 |

| ネットワーク | 無線:○ |

| 接続端子 | USB:1個 SDカードスロット |

| 内蔵機能 | WEBカメラ / Bluetooth / スピーカー / テンキー |

| インターフェース | マイク入力/ヘッドホン出力端子×1 Thunderbolt™ 3(USB Type-C™)コネクタ(電源コネクタ)×2 HDMI ® 出力端子×1 |

| 付属品 | 電源アダプタ / ACケーブル |

| 外形寸法 | 約316.0(幅)×227.0(奥行)×15.9(高さ)mm 約1,090g |

料金

税込? 79200円 ?(税抜72000円)→ 税込? 72000 円 ?(※在庫処分)

お問い合わせ

※商品タイトルを「題名」にコピーして送信してください

[contact-form-7]

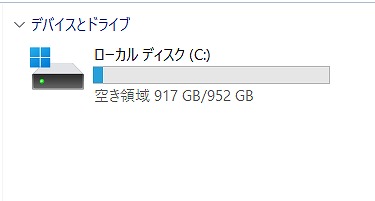

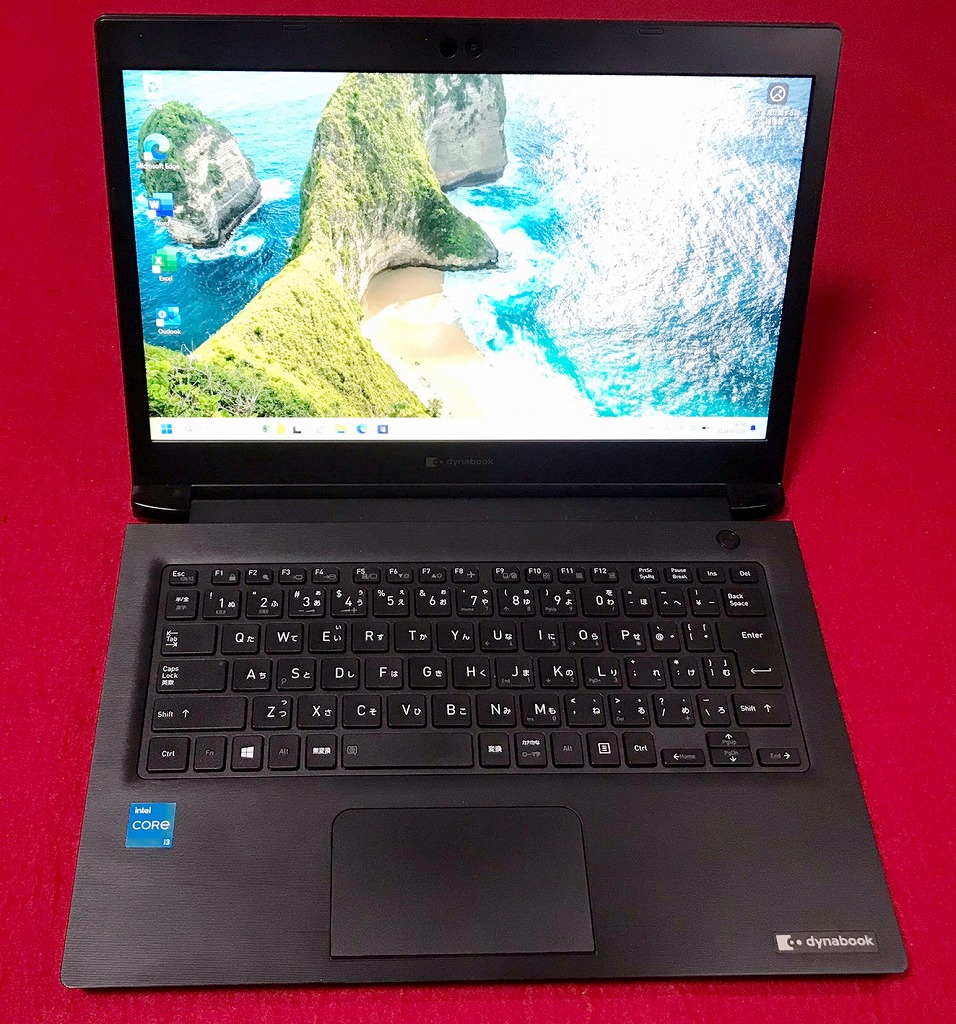

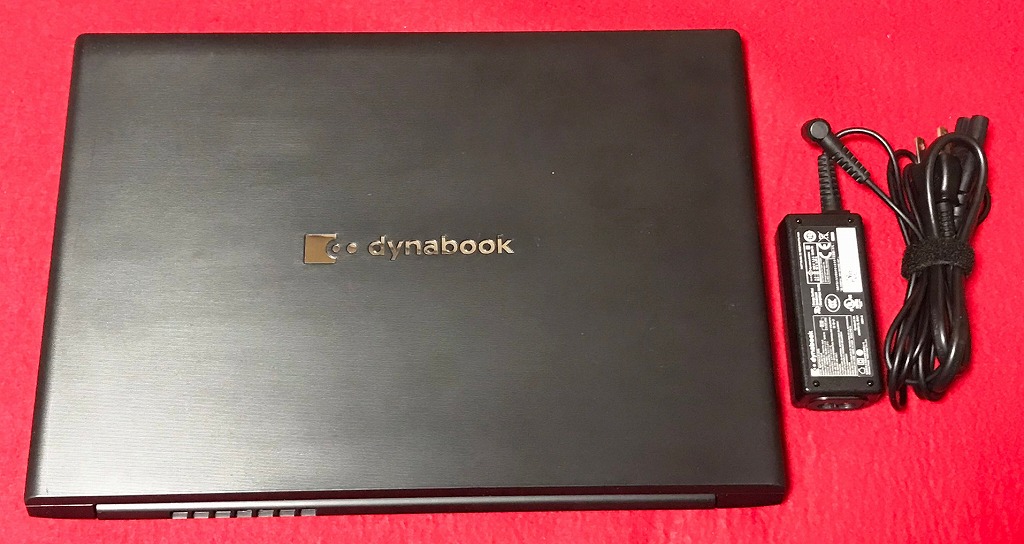

74800円 → 税込? 68000 円 ?(※在庫処分)

Dynabook S73/HS・第11世代Corei3・メモリ16G・新品SSD500G・Win11Pro・13.3型FHD・office2021

参考資料

ある学校に配布されたパソコン販売パンフレット

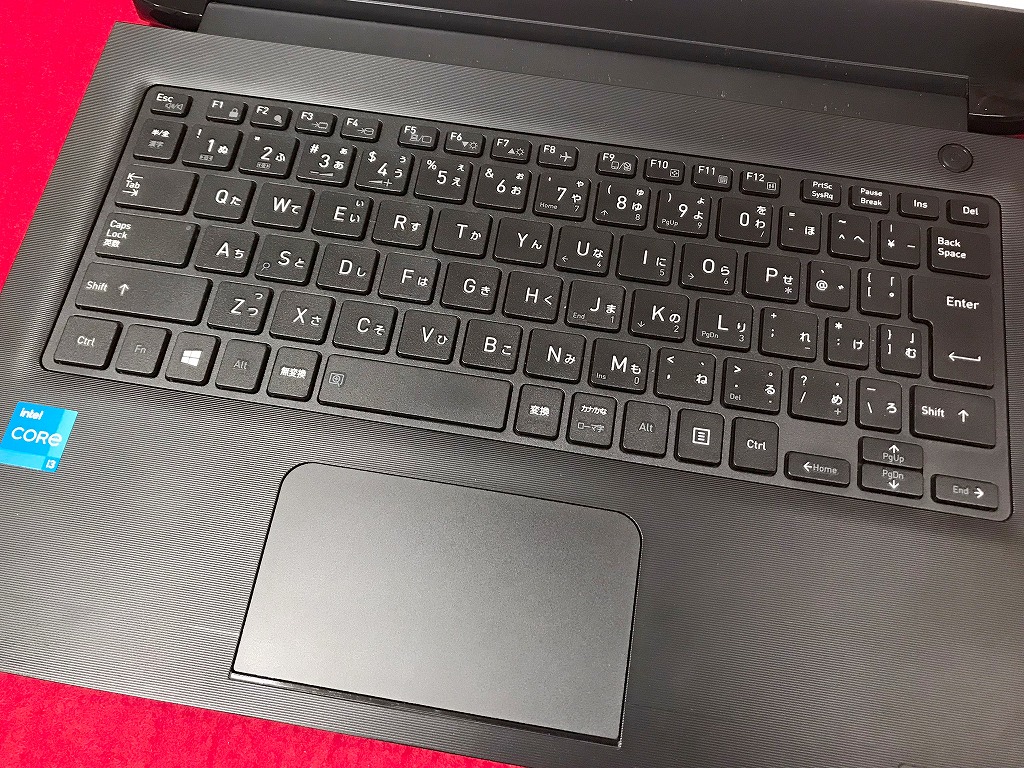

ギャラリー

説明

Intel Core i3プロセッサー&メモリ16GB搭載で、動作も快適♪

- M.2 NVMe SSD 500GB【新品】

※一般的なSSDより高速

- 超軽量で丈夫なモデルです。その上、性能も申し分ありません。

- 高性能なCPUの Core i3 、大容量の新品 M.2 SSD 500GB (読み書きが速い!)と,大容量 メモリ16GB で、動画編集もいけます。

- 最新の Microsoft office 2021 Professional Plus インストール済み!

無線LAN内蔵なので、家の中でもケーブル不要・場所を選ばずネットが出来ます!

新品に近く使用感も少なく、ある程度美品に思います。

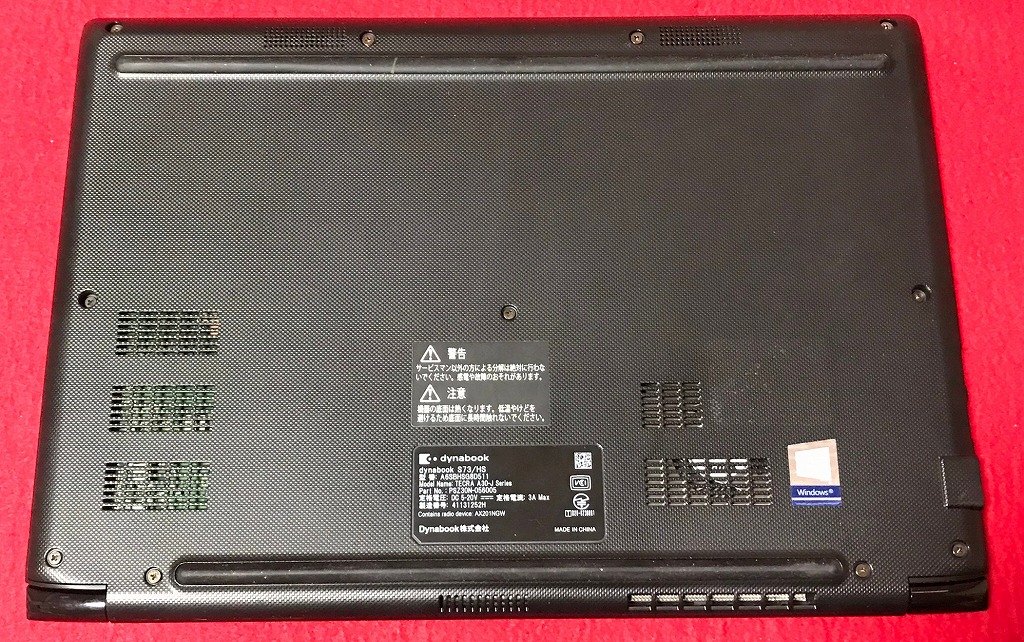

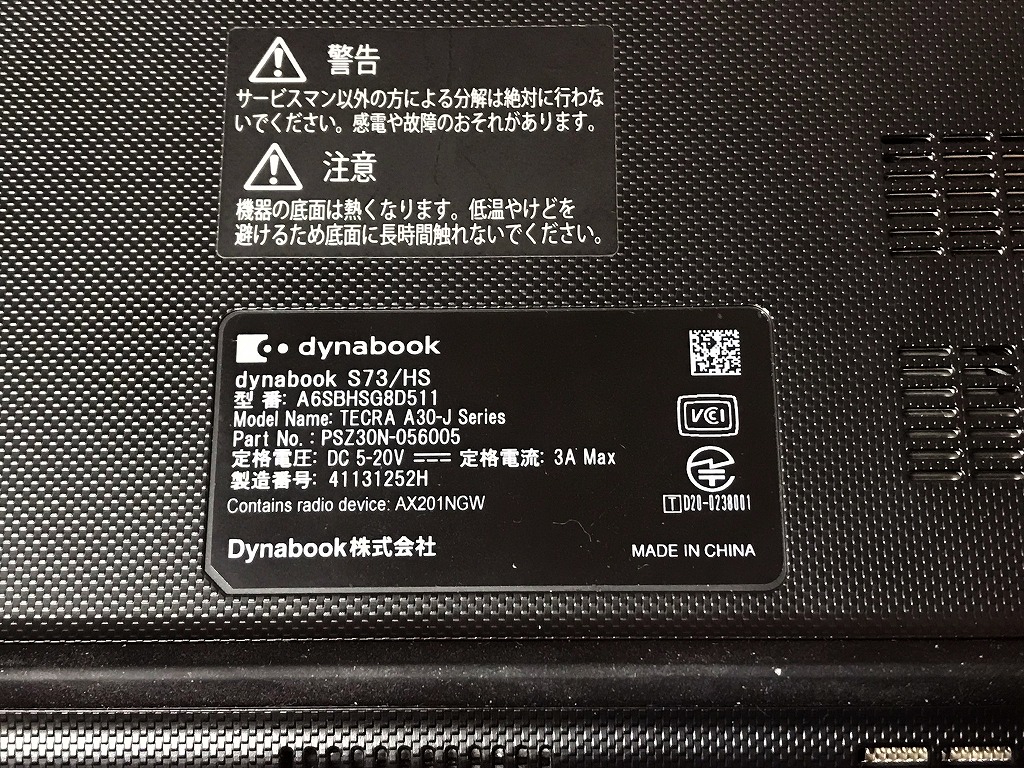

| 状態 | 中古品【美品】 |

|---|---|

| パソコンメーカー | TOSHIBA |

| 型番 | Dynabook S73/HS |

| カラー | ブラック |

| CPU | Core i3-1115G4 |

| メモリ | 16 GB |

| ストレージ | M.2 NVMeSSD 500GB【新品】 |

| 表示能力 | 13.3型 |

| 解像度 | 1920×1080ドット |

| OS | Windows11 Pro |

| ソフト | Microsoft Office Professional plus 2021 |

| 光学ドライブ | 無 |

| ネットワーク | 有線:〇 / 無線:○ |

| 接続端子 | USB3.1 Gen1(USB3.0) Type-Ax2/Type-Cx1 |

| 内蔵機能 | WEBカメラ / Bluetooth / スピーカー / テンキー |

| インターフェース | HDMIx1 microSDスロット |

| 付属品 | 電源アダプタ / ACケーブル |

| 外形寸法 | 316 x 19.9 x 227 mm, 1.269 kg |

料金

税込? 74800円 ?(税抜68000円)→ 税込? 68000 円 ?(※在庫処分)

お問い合わせ

※商品タイトルを「題名」にコピーして送信してください

[contact-form-7]

はじめに

再度、stable video diffusionで動画を生成してみる。

生成過程

Stable Diffusion でAI画像生成

stable video diffusionでAI動画生成

VideoProc Vloggerで動画制作

動画完成

はじめに

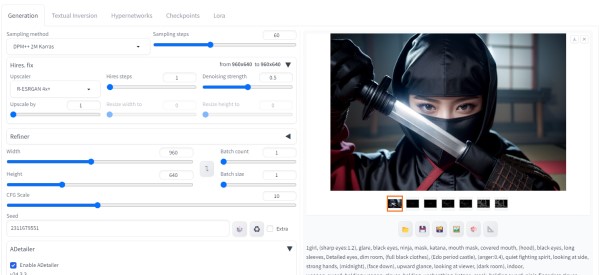

映画のような綺麗な画像を作ってみたいと思った。

忍者のスタイルで、まずは試みた。

生成過程

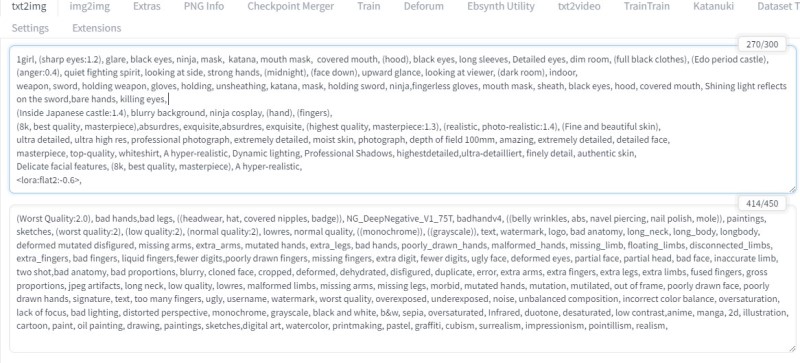

プロンプト

Hires.fix、ADetailerなどを使用

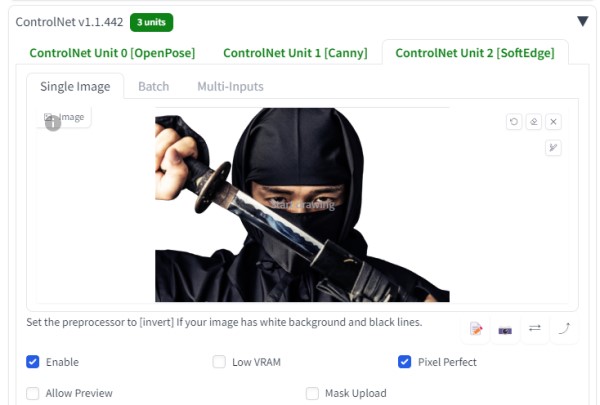

ControlNet【OpenPose:Canny:SoftEdge】を使用

くノ一【ギャラリー】

はじめに

Canvaでアニメーションを作成できることがわかった

参考サイト

CANVAで人が話すアニメーション動画を作成する方法

アニメーション作成

Canva

音読さん

Canva作成過程

アニメーション完成

考察

口パクが簡単にできた。

音読さんにより、ナレーションも簡単にできた。

タスクバーの左揃え

- タスクバーを右クリックし、タスクバーの設定をクリック

- タスクバーの動作まで移動

- 「中央揃え」から「左揃え」へ変更する

タスクバーが「左揃え」になりました